Учебник CSS

Невозможно отучить людей изучать самые ненужные предметы.

Введение в CSS

Преимущества стилей

Добавления стилей

Типы носителей

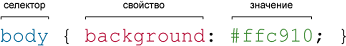

Базовый синтаксис

Значения стилевых свойств

Селекторы тегов

Классы

CSS3

Надо знать обо всем понемножку, но все о немногом.

Идентификаторы

Контекстные селекторы

Соседние селекторы

Дочерние селекторы

Селекторы атрибутов

Универсальный селектор

Псевдоклассы

Псевдоэлементы

Кто умеет, тот делает. Кто не умеет, тот учит. Кто не умеет учить - становится деканом. (Т. Мартин)

Группирование

Наследование

Каскадирование

Валидация

Идентификаторы и классы

Написание эффективного кода

Самоучитель CSS

Вёрстка

Изображения

Текст

Цвет

Линии и рамки

Углы

Списки

Ссылки

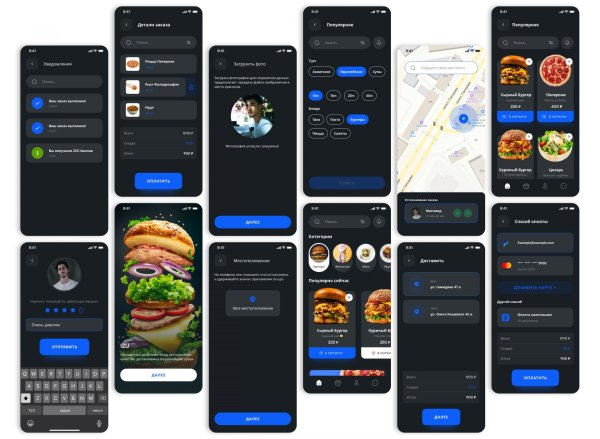

Дизайны сайтов

Формы

Таблицы

CSS3

HTML5

Новости

Блог для вебмастеров

Новости мира Интернет

Сайтостроение

Ремонт и советы

Все новости

Справочник CSS

Справочник от А до Я

HTML, CSS, JavaScript

Афоризмы

Афоризмы о учёбе

Статьи об афоризмах

Все Афоризмы

| Помогли мы вам |

Nikon заинтересовалась машинным зрением и глубоким обучением - «Новости сети»

Информация размещенная на сайте - «hs-design.ru»

- © Планы в отношении фотосистемы Nikon Z на 2018 и 2019 годы - «Новости сети»

- © Nikon перенесла релиз новинок из-за землетрясения - «Новости сети»

- © Nikon прекратила продажи беззеркальных камер Nikon 1 - «Новости сети»

- © Nikon сфокусируется на 8K-камерах и медицинском оборудовании - «Новости сети»

- © Дебют объектива Tamron 18-400mm F3.5-6.3 Di II VC HLD для камер Canon и Nikon - «Новости сети»

- © Nikon представила фотоаппарат со 125-кратным зумом - «Интернет и связь»

- © Zeiss Milvus 1.4/25: объектив для полнокадровых фотокамер Canon и Nikon - «Новости сети»

- © Nikon планирует выпуск «серьёзной» беззеркальной фотокамеры - «Новости сети»

- © Nikon готовит две новые беззеркальные фотокамеры - «Новости сети»

- © Полнокадровая беззеркальная камера Nikon может получить новый байонет Z-Mount - «Новости сети»

|

|

|