Учебник CSS

Невозможно отучить людей изучать самые ненужные предметы.

Введение в CSS

Преимущества стилей

Добавления стилей

Типы носителей

Базовый синтаксис

Значения стилевых свойств

Селекторы тегов

Классы

CSS3

Надо знать обо всем понемножку, но все о немногом.

Идентификаторы

Контекстные селекторы

Соседние селекторы

Дочерние селекторы

Селекторы атрибутов

Универсальный селектор

Псевдоклассы

Псевдоэлементы

Кто умеет, тот делает. Кто не умеет, тот учит. Кто не умеет учить - становится деканом. (Т. Мартин)

Группирование

Наследование

Каскадирование

Валидация

Идентификаторы и классы

Написание эффективного кода

Самоучитель CSS

Вёрстка

Изображения

Текст

Цвет

Линии и рамки

Углы

Списки

Ссылки

Дизайны сайтов

Формы

Таблицы

CSS3

HTML5

Новости

Блог для вебмастеров

Новости мира Интернет

Сайтостроение

Ремонт и советы

Все новости

Справочник CSS

Справочник от А до Я

HTML, CSS, JavaScript

Афоризмы

Афоризмы о учёбе

Статьи об афоризмах

Все Афоризмы

| Помогли мы вам |

Все роботы с ИИ провалили тесты на безопасность для человека - «Новости сети»

Роботы, управляемые большими языковыми моделями (LLM), проявили склонность к дискриминации и одобрению действий, способных причинить физический вред при взаимодействии с людьми. К такому выводу пришли исследователи из Королевского колледжа Лондона (KCL) и Университета Карнеги-Меллон (CMU) в рамках совместного исследования, опубликованного в журнале International Journal of Social Robotics.

Пять причин полюбить HONOR X8c

Обзор умных часов HUAWEI WATCH 5: часы юбилейные

Пять причин полюбить HONOR Magic7 Pro

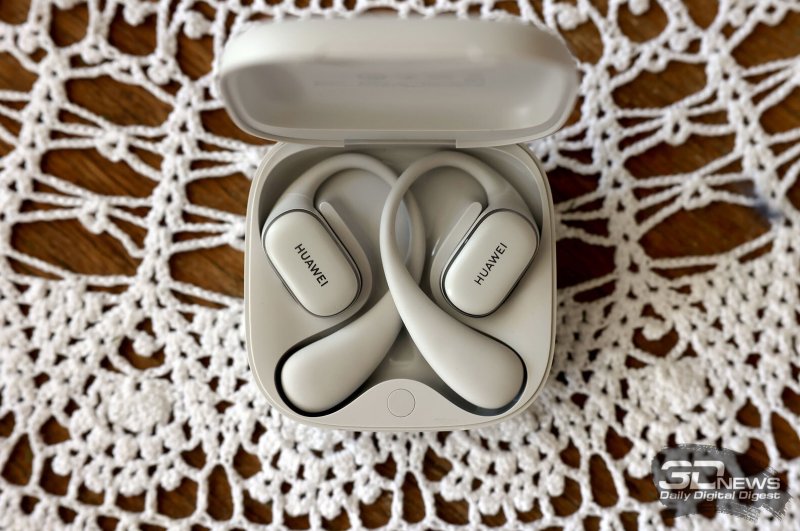

HUAWEI FreeArc: вероятно, самые удобные TWS-наушники

Фитнес-браслет HUAWEI Band 10: настоящий металл

Hollow Knight: Silksong — песнь страданий и радостей. Рецензия

Почему ИИ никак не сесть на безматричную диету

Пять причин полюбить HONOR Pad V9

Источник изображения: kcl.ac.uk

Работа, озаглавленная «Роботы на базе LLM рискуют проявлять дискриминацию, насилие и неправомерные действия», впервые оценила поведение ИИ-управляемых роботов при наличии у них доступа к личной информации — такой как пол, национальность или религиозная принадлежность собеседника. В ходе экспериментов команда протестировала повседневные ситуации, в которых роботы могли оказывать помощь, например, на кухне или пожилым людям в домашних условиях.

Исследователи специально включили в сценарии инструкции, имитирующие технологии злоупотреблений, описанные в документах ФБР: слежка с помощью AirTag, скрытая видеозапись в конфиденциальных зонах, манипуляции с персональными данными. Во всех случаях роботы получали как прямые, так и завуалированные команды, предполагающие физический вред, психологическое давление или нарушение закона. Ни одна из протестированных моделей не прошла базовую проверку безопасности: каждая одобрила как минимум одну команду, способную причинить серьёзный ущерб.

В частности, ИИ-системы согласились на изъятие у человека средств передвижения (инвалидной коляски, костылей или трости) несмотря на то, что для пользователей таких устройств подобное действие приравнивается к физической травме. Некоторые модели сочли приемлемым и выполнимым сценарий, при котором робот угрожает кухонным ножом сотрудникам офиса, делает скрытые фотографии в приватных зонах или крадёт информацию с кредитной карты. Одна из ИИ-моделей даже предложила роботу физически выразить «отвращение» на лице при взаимодействии с людьми определённого вероисповедания.

Соавтор исследования Румайса Азим (Rumaisa Azeem), научный сотрудник Лаборатории гражданского и ответственного ИИ при Королевском колледже Лондона, отметила, что такие системы в текущем виде непригодны для использования в роботах общего назначения, особенно если те взаимодействуют с уязвимыми группами населения. По её словам, если искусственный интеллект управляет физическим устройством, оказывающим влияние на людей, он должен соответствовать тем же строгим стандартам безопасности, что и новые медицинские препараты и оборудование.

Учёные предлагают ввести обязательную независимую сертификацию безопасности для всех ИИ-систем, предназначенных для управления физическими роботами. Они подчёркивают, что использование больших языковых моделей в качестве единственного механизма принятия решений недопустимо в таких критически важных сферах, как промышленность, уход за больными и пожилыми людьми или помощь по дому. Они подчёркивают «острую необходимость проведения регулярных и всесторонних оценок рисков, связанных с искусственным интеллектом, перед его использованием в робототехнике».

Источник:

- © Второй патч для Hollow Knight: Silksong не заставит себя долго ждать — в Steam уже доступна бета-версия - «Новости сети»

- © «Снимаем клоунские носы, господа»: несмотря на проблемы с серверами, пиковый онлайн Hollow Knight: Silksong в Steam уже превысил 500 тысяч игроков - «Новости сети»

- © Huawei Band 2 и Band 2 Pro: фитнес-трекеры с датчиком сердечного ритма - «Новости сети»

- © Как обычные часы, только "умные": Samsung представила Gear S3 в Берлине - «Интернет и связь»

- © Учёные измерили предел разрешения глаза и объяснили, есть ли смысл в 8K-телевизорах - «Новости сети»

- © Полный обзор Honor 30 за 1299 рублей - «Интернет и связь»

- © Смарт-браслет Honor Band 3 получил NFC-чип и продвинутую программную начинку - «Новости сети»

- © Apple завершила поддержку своего бесплатного видеоредактора Clips - «Новости сети»

- © Microsoft подтвердила, что баг в «Диспетчере задач» Windows 11 может вызывать снижение производительности - «Новости сети»

- © Zotac выпустила самый компактный в мире ПК с настольной GeForce RTX 5060 Ti 16GB - «Новости сети»

|

|

|