Учебник CSS

Невозможно отучить людей изучать самые ненужные предметы.

Введение в CSS

Преимущества стилей

Добавления стилей

Типы носителей

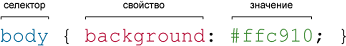

Базовый синтаксис

Значения стилевых свойств

Селекторы тегов

Классы

CSS3

Надо знать обо всем понемножку, но все о немногом.

Идентификаторы

Контекстные селекторы

Соседние селекторы

Дочерние селекторы

Селекторы атрибутов

Универсальный селектор

Псевдоклассы

Псевдоэлементы

Кто умеет, тот делает. Кто не умеет, тот учит. Кто не умеет учить - становится деканом. (Т. Мартин)

Группирование

Наследование

Каскадирование

Валидация

Идентификаторы и классы

Написание эффективного кода

Самоучитель CSS

Вёрстка

Изображения

Текст

Цвет

Линии и рамки

Углы

Списки

Ссылки

Дизайны сайтов

Формы

Таблицы

CSS3

HTML5

Новости

Блог для вебмастеров

Новости мира Интернет

Сайтостроение

Ремонт и советы

Все новости

Справочник CSS

Справочник от А до Я

HTML, CSS, JavaScript

Афоризмы

Афоризмы о учёбе

Статьи об афоризмах

Все Афоризмы

| Помогли мы вам |

ООН: женские голоса Siri и Alexa создают иллюзию доступности женщин - «Интернет и связь»

По мнению ООН, присвоение женских полов цифровым ассистентам, таким как Apple Siri и Amazon Alexa, помогает в закреплении вредных гендерных предрассудков, а также поощряет сексистские и оскорбительные выражения со стороны пользователей. Об этом сообщает Guardian.

Отчет ЮНЕСКО называется «Я бы покраснела, если б могла» — это обычный ответ голосового помощника Apple Siri на провокационные вопросы или попытки флирта. Например, так Сири отзывается на фразу: «Ты шлюха». Alexa в этом случае произносит: «Ну, спасибо за обратную связь».

Авторы отчета считают, что женщин-помощников часто изображают как «жаждущих угодить». «Поскольку речь большинства голосовых помощников является женской, она посылает сигнал о том, что женщины… покорные помощники, доступные по нажатию кнопки или с помощью грубой голосовой команды, такой как „Эй“ или „Окей“», — сказано в отчете. Кроме того, цифровые ассистенты дают «слабые или извиняющиеся ответы» на злоупотребления или критику со стороны пользователя, выполняют команды и отвечают на запросы независимо от их тона или враждебности. По мнению ЮНЕСКО, во многих сообществах это «усиливает общепринятые предрассудки в отношении пола и того, что женщины подчинены и терпимы к плохому обращению».

В документе также говорится, что в таких фирмах большинство работников — мужчины, которые создали системы искусственного интеллекта и «заставляют феминизированных цифровых помощников приветствовать словесные оскорбления при помощи флирта «поймай меня, если можешь».

Напомним, что в марте группа активистов представила голосового ассистента Q с абсолютно нейтральным бесполым голосом.

Читайте также

Трамп назвал способ решения проблемы с Huawei

Посмотрите, как будет выглядеть новый флагман Xiaomi

Крупнейший производитель процессоров поддержал Huawei

Если вы заметили ошибку в тексте новости, пожалуйста, выделите её и нажмите Ctrl+Enter

- © "Siri, Крым наш?" Смешные и неожиданные ответы голосового помощника Apple на русском - «Интернет и связь»

- © Amazon готовит планшет со встроенным голосовым помощником Alexa - «Новости сети»

- © Русскоязычную версию Siri обвинили в гомофобии из-за отказа показывать ближайшие гей-бары - «Интернет и связь»

- © Голосовой ассистент Amazon Alexa начнёт общаться с автомобилями Nissan - «Новости сети»

- © Голосовой ассистент Alexa поселился в ноутбуках Acer - «Новости сети»

- © Голосовой ассистент Amazon Alexa поселится в автомобилях BMW и MINI - «Новости сети»

- © Siri перебила британского министра обороны, чтобы рассказать о Сирии - «Интернет и связь»

- © Amazon Smart Plug: голосовой ассистент Alexa в каждой розетке - «Новости сети»

- © Siri от Apple сменила поиск от Google на поиск от Microsoft - «Интернет и связь»

- © Amazon Alexa может получить собственный чип для ИИ-расчётов - «Новости сети»

|

|

|