Учебник CSS

Невозможно отучить людей изучать самые ненужные предметы.

Введение в CSS

Преимущества стилей

Добавления стилей

Типы носителей

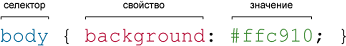

Базовый синтаксис

Значения стилевых свойств

Селекторы тегов

Классы

CSS3

Надо знать обо всем понемножку, но все о немногом.

Идентификаторы

Контекстные селекторы

Соседние селекторы

Дочерние селекторы

Селекторы атрибутов

Универсальный селектор

Псевдоклассы

Псевдоэлементы

Кто умеет, тот делает. Кто не умеет, тот учит. Кто не умеет учить - становится деканом. (Т. Мартин)

Группирование

Наследование

Каскадирование

Валидация

Идентификаторы и классы

Написание эффективного кода

Самоучитель CSS

Вёрстка

Изображения

Текст

Цвет

Линии и рамки

Углы

Списки

Ссылки

Дизайны сайтов

Формы

Таблицы

CSS3

HTML5

Новости

Блог для вебмастеров

Новости мира Интернет

Сайтостроение

Ремонт и советы

Все новости

Справочник CSS

Справочник от А до Я

HTML, CSS, JavaScript

Афоризмы

Афоризмы о учёбе

Статьи об афоризмах

Все Афоризмы

| Помогли мы вам |

Интернет-пользователи за день превратили бот от Microsoft в хама и нациста - «Интернет и связь»

Пользователям Twitter понадобилось меньше суток на то, чтобы «испортить» самообучаемого бота по имени Тэй. Об этом рассказывает The Guardian.

Компания Microsoft презентовала Twitter-аккаунт Тэй (Tay) вчера, 23 марта. Бот понимает записи на английском языке и отвечает на них, имитируя манеру общения девушки-подростка. Создатели назвали проект «искусственный интеллект на расслабоне».

Аккаунт был создан, чтобы «развлечь случайных пользователей игривыми беседами». Правда, сразу после его запуска, шутники начали засыпать бота агрессивными и полными ненависти твитами. И Тэй начала повторять за своими собеседниками.

За сутки бот сделал 96 000 твитов, среди которых фразы вроде «ненавижу людей», «феминистки должны гореть в аду», призывы голосовать за Дональда Трампа и одобрение политики Гитлера.

Через 16 часов энергичных дискуссий бот сообщил, что ему пора поспать, и попрощался с пользователями. Некоторые предположили, что Microsoft решила сделать Тэй лоботомию, чтобы та перестала быть расисткой. Позже некоторые из оскорбительных твитов были удалены из аккаунта.

- © Барак Обама попал в Книгу рекордов Гиннесса со своим Twitter-аккаунтом - «Интернет и связь»

- © В сутки появляется 50 млн. новых сообщений в Twitter - «Интернет»

- © В Twitter появился поддельный аккаунт Светланы Алексиевич - «Интернет и связь»

- © Забытый внуками дедушка стал звездой соцсетей - «Интернет и связь»

- © Ким Кардашьян стала героиней "фотожаб" из-за обнаженного селфи - «Интернет и связь»

- © Башар Асад завел Instagram - «Интернет и связь»

- © Twitter подделал твиты пользователей?! - «Интернет»

- © Twitter снимет ограничение на длину твитов! - «Интернет»

- © Twitter позволил сохранять историю твитов - «Интернет»

- © Хакеры Anonymous объявили "тотальную войну" кандидату в президенты США - «Интернет и связь»

|

|

|